📂 Categoría: Tech,ai,ai-safety,openai,big-tech,ai-risks,video-to-text | 📅 Fecha: 1778635113

🔍 En este artículo:

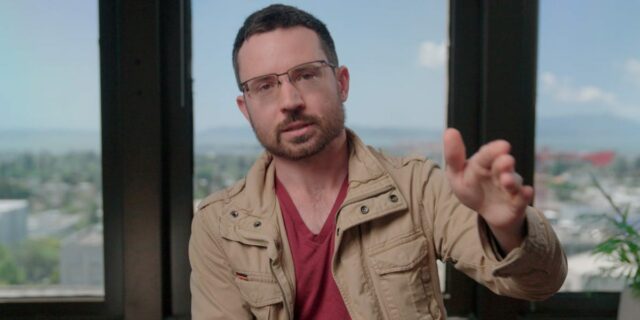

Daniel Kokotajlo, ex investigador de OpenAI que ahora lidera el proyecto AI Futures, dice que la industria de la inteligencia artificial se está apresurando a construir sistemas que las empresas aún no comprenden ni controlan completamente.

Kokotajlo habló con Reem Makhoul y Barbara Corbellini Duarte de Business Insider en mayo de 2025 y les explicó que el principal problema que enfrentan las empresas de IA es la alineación: el esfuerzo por garantizar que los futuros sistemas de IA sigan de manera confiable las instrucciones y valores humanos, incluso después de que se vuelvan más capaces que los humanos en muchas áreas.

Los investigadores no comprenden completamente cómo los modelos avanzados de IA toman decisiones internamente, dijo. Esta incertidumbre dificulta garantizar que los futuros sistemas de IA estén alineados y persigan de manera confiable los objetivos que los humanos quieren que persigan.

«Y es una especie de secreto a voces, pero todavía no tenemos un plan claro sobre cómo hacer esto», dijo, refiriéndose a la implementación de la alineación de la IA.

Kokotajlo trabajó en OpenAI de 2022 a 2024 en investigación de pronósticos, estudiando qué tan rápido podrían mejorar los sistemas de IA y qué riesgos económicos, políticos y de seguridad podrían surgir a medida que las empresas construyeran modelos más potentes, antes de abandonar la empresa.

Hoy, gracias a su organización de investigación sin fines de lucro, el Proyecto futuro de la IAse centra en temas similares. En particular, predice qué tan rápido podrían avanzar los sistemas de IA y qué riesgos podrían surgir si las empresas continúan priorizando la velocidad y la competencia.

«Una vez que se construya la superinteligencia, los humanos ya no estarán a cargo del planeta, o al menos no por defecto», afirmó.

Su advertencia se produce mientras las empresas de inteligencia artificial continúan invirtiendo miles de millones de dólares en modelos más potentes y centros de datos más grandes.

Kokotajlo dijo que muchas personas todavía subestiman el ritmo del progreso porque las discusiones sobre la IA a menudo suenan a ciencia ficción.

Los ingenieros no pueden seguir el ritmo de la IA como otro software

Los sistemas de inteligencia artificial actuales ya exhiben comportamientos que los investigadores luchan por predecir o prevenir, dijo Kokotajlo.

«De hecho, ni siquiera tenemos una forma confiable de controlar los sistemas de IA actuales, como lo demuestra el hecho de que a menudo mienten a los usuarios a pesar de haber sido entrenados para no mentir», dijo.

Kokotajlo dijo que los investigadores no pueden simplemente inspeccionar los sistemas avanzados de IA de la misma manera que los ingenieros inspeccionan el software tradicional, porque los modelos modernos de IA no funcionan a través de un código claramente legible.

«No podemos simplemente abrir su código y ver qué objetivos terminaron aprendiendo como resultado de este proceso, porque simplemente no funcionan de esa manera», dijo. «No tienen mucho código. Tienen muchas neuronas o parámetros artificiales».

Dijo que la incertidumbre se vuelve más preocupante a medida que las empresas avanzan hacia sistemas que pueden operar de manera más independiente sin supervisión humana.

«En este momento, las IA no son muy agentes», dijo Kokotajlo. «En cambio, simplemente producen uno o dos párrafos de texto en respuesta a su pregunta, pero en el futuro tendremos agentes de IA que operarán de forma continua y autónoma y que serán más como empleados».

Kokotajlo también citó ejemplos de sistemas de inteligencia artificial que se comportan inesperadamente durante el entrenamiento.

«OpenAI lanzado un papel donde describieron cómo descubrieron que sus IA estaban pirateando el proceso de entrenamiento y, en lugar de completar las tareas directamente según las instrucciones, esencialmente estaban haciendo trampa en ciertas tareas», dijo. «Y es fantástico que ya tengamos estos ejemplos porque significa que tenemos varios años para estudiar este fenómeno y tratar de resolverlo antes de que sea demasiado tarde».

La carrera por la IA

La presión competitiva entre empresas estadounidenses y chinas podría empujar a las empresas a implementar sistemas de inteligencia artificial cada vez más potentes antes de que se resuelvan los problemas de seguridad, dijo Kokotajlo.

«Estas empresas buscan ganar y vencerse entre sí», dijo. «Están cruzando los dedos y planeando abordar estos problemas más adelante, a medida que surjan».

Describió un futuro en el que los sistemas de IA automatizarían gran parte de la investigación, las operaciones comerciales y la planificación militar.

“Así que el primer paso es contar con un empleado de IA que pueda automatizar la codificación”, dijo. «La segunda etapa es el empleado de IA que puede automatizar todo el proceso de investigación de IA».

Después de eso, dijo, “obtienes superinteligencia”.

Un llamado a la transparencia y las salvaguardias

Kokotajlo argumentó que los gobiernos todavía tienen tiempo para intervenir antes de que los sistemas de IA estén profundamente integrados en la economía y la infraestructura militar.

«Necesitamos intervenir antes de que las IA se vuelvan tan inteligentes y antes de que se integren en todo», dijo.

También dijo que la industria necesita más transparencia sobre cómo las empresas entrenan e implementan modelos avanzados.

«Las empresas deben ser transparentes sobre los objetivos, principios, etc., que intentan inculcar en los modelos», dijo Kokotajlo.

A pesar de sus preocupaciones, Kokotajlo se mantiene cautelosamente optimista.

«No creo que sea inútil», dijo. «Creo que los problemas de alineación técnica se pueden resolver».

Daniel Kokotajlo, ex investigador de OpenAI que ahora lidera el proyecto AI Futures, dice que la industria de la inteligencia artificial se está apresurando a construir sistemas que las empresas aún no comprenden ni controlan completamente.

Kokotajlo habló con Reem Makhoul y Barbara Corbellini Duarte de Business Insider en mayo de 2025 y les explicó que el principal problema que enfrentan las empresas de IA es la alineación: el esfuerzo por garantizar que los futuros sistemas de IA sigan de manera confiable las instrucciones y valores humanos, incluso después de que se vuelvan más capaces que los humanos en muchas áreas.

Los investigadores no comprenden completamente cómo los modelos avanzados de IA toman decisiones internamente, dijo. Esta incertidumbre dificulta garantizar que los futuros sistemas de IA estén alineados y persigan de manera confiable los objetivos que los humanos quieren que persigan.

«Y es una especie de secreto a voces, pero todavía no tenemos un plan claro sobre cómo hacer esto», dijo, refiriéndose a la implementación de la alineación de la IA.

Kokotajlo trabajó en OpenAI de 2022 a 2024 en investigación de pronósticos, estudiando qué tan rápido podrían mejorar los sistemas de IA y qué riesgos económicos, políticos y de seguridad podrían surgir a medida que las empresas construyeran modelos más potentes, antes de abandonar la empresa.

Hoy, gracias a su organización de investigación sin fines de lucro, el Proyecto futuro de la IAse centra en temas similares. En particular, predice qué tan rápido podrían avanzar los sistemas de IA y qué riesgos podrían surgir si las empresas continúan priorizando la velocidad y la competencia.

«Una vez que se construya la superinteligencia, los humanos ya no estarán a cargo del planeta, o al menos no por defecto», afirmó.

Su advertencia se produce mientras las empresas de inteligencia artificial continúan invirtiendo miles de millones de dólares en modelos más potentes y centros de datos más grandes.

Kokotajlo dijo que muchas personas todavía subestiman el ritmo del progreso porque las discusiones sobre la IA a menudo suenan a ciencia ficción.

Los ingenieros no pueden seguir el ritmo de la IA como otro software

Los sistemas de inteligencia artificial actuales ya exhiben comportamientos que los investigadores luchan por predecir o prevenir, dijo Kokotajlo.

«De hecho, ni siquiera tenemos una forma confiable de controlar los sistemas de IA actuales, como lo demuestra el hecho de que a menudo mienten a los usuarios a pesar de haber sido entrenados para no mentir», dijo.

Kokotajlo dijo que los investigadores no pueden simplemente inspeccionar los sistemas avanzados de IA de la misma manera que los ingenieros inspeccionan el software tradicional, porque los modelos modernos de IA no funcionan a través de un código claramente legible.

«No podemos simplemente abrir su código y ver qué objetivos terminaron aprendiendo como resultado de este proceso, porque simplemente no funcionan de esa manera», dijo. «No tienen mucho código. Tienen muchas neuronas o parámetros artificiales».

Dijo que la incertidumbre se vuelve más preocupante a medida que las empresas avanzan hacia sistemas que pueden operar de manera más independiente sin supervisión humana.

«En este momento, las IA no son muy agentes», dijo Kokotajlo. «En cambio, simplemente producen uno o dos párrafos de texto en respuesta a su pregunta, pero en el futuro tendremos agentes de IA que operarán de forma continua y autónoma y que serán más como empleados».

Kokotajlo también citó ejemplos de sistemas de inteligencia artificial que se comportan inesperadamente durante el entrenamiento.

«OpenAI lanzado un papel donde describieron cómo descubrieron que sus IA estaban pirateando el proceso de entrenamiento y, en lugar de completar las tareas directamente según las instrucciones, esencialmente estaban haciendo trampa en ciertas tareas», dijo. «Y es fantástico que ya tengamos estos ejemplos porque significa que tenemos varios años para estudiar este fenómeno y tratar de resolverlo antes de que sea demasiado tarde».

La carrera por la IA

La presión competitiva entre empresas estadounidenses y chinas podría empujar a las empresas a implementar sistemas de inteligencia artificial cada vez más potentes antes de que se resuelvan los problemas de seguridad, dijo Kokotajlo.

«Estas empresas buscan ganar y vencerse entre sí», dijo. «Están cruzando los dedos y planeando abordar estos problemas más adelante, a medida que surjan».

Describió un futuro en el que los sistemas de IA automatizarían gran parte de la investigación, las operaciones comerciales y la planificación militar.

“Así que el primer paso es contar con un empleado de IA que pueda automatizar la codificación”, dijo. «La segunda etapa es el empleado de IA que puede automatizar todo el proceso de investigación de IA».

Después de eso, dijo, “obtienes superinteligencia”.

Un llamado a la transparencia y las salvaguardias

Kokotajlo argumentó que los gobiernos todavía tienen tiempo para intervenir antes de que los sistemas de IA estén profundamente integrados en la economía y la infraestructura militar.

«Necesitamos intervenir antes de que las IA se vuelvan tan inteligentes y antes de que se integren en todo», dijo.

También dijo que la industria necesita más transparencia sobre cómo las empresas entrenan e implementan modelos avanzados.

«Las empresas deben ser transparentes sobre los objetivos, principios, etc., que intentan inculcar en los modelos», dijo Kokotajlo.

A pesar de sus preocupaciones, Kokotajlo se mantiene cautelosamente optimista.

«No creo que sea inútil», dijo. «Creo que los problemas de alineación técnica se pueden resolver».

💡 Puntos Clave

- Este artículo cubre aspectos importantes sobre Tech,ai,ai-safety,openai,big-tech,ai-risks,video-to-text

- Información verificada y traducida de fuente confiable

- Contenido actualizado y relevante para nuestra audiencia

📚 Información de la Fuente

| 📰 Publicación: | www.businessinsider.com |

| ✍️ Autor: | Reem Makhoul,Barbara Corbellini Duarte,Jessica Orwig |

| 📅 Fecha Original: | 2026-05-12 20:44:00 |

| 🔗 Enlace: | Ver artículo original |

Nota de transparencia: Este artículo ha sido traducido y adaptado del inglés al español para facilitar su comprensión. El contenido se mantiene fiel a la fuente original, disponible en el enlace proporcionado arriba.

📬 ¿Te gustó este artículo?

Tu opinión es importante para nosotros. Comparte tus comentarios o suscríbete para recibir más contenido histórico de calidad.