📂 Categoría: AI,ai-agents,genai | 📅 Fecha: 1775896298

🔍 En este artículo:

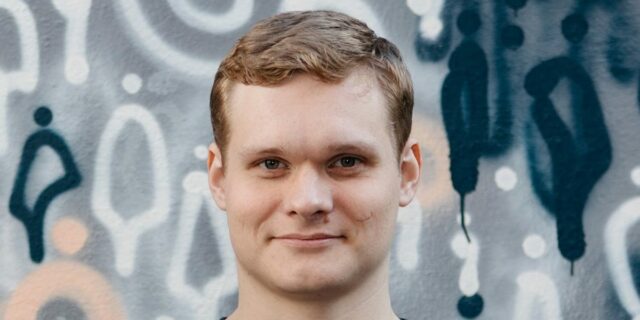

Cada día, Illia Polosukhin tiene una docena de agentes que realizan para él diferentes “misiones”.

Una de esas misiones podría ser: «Quiero convertirme en un mejor director ejecutivo», dijo.

«Por lo tanto, resume de manera efectiva todas las notas de la reunión, los documentos de Google Drive y Slack, y me brinda orientación y un resumen de lo que sucedió, lo que me falta y dónde están estancadas las decisiones», dijo Polosukhin a Business Insider Posts. «Así sucede todas las semanas».

Polosukhin llama a estos agentes su “nivel de apoyo de jefe de personal multimillonario”. La descripción está «literalmente» en el mensaje y dice: «Usted es el jefe de gabinete de un multimillonario».

Es un primer vistazo del futuro que Polosukhin imagina no sólo para los trabajadores individuales o los directores ejecutivos, sino para toda la economía global: un mundo donde los agentes puedan realizar transacciones, coordinar cadenas de suministro y negociar acuerdos en nombre de individuos y grandes corporaciones. Y según él, no estamos en absoluto preparados para ello.

«Creo que el mayor problema es que fundamentalmente no hemos preparado el sistema para que la AGI (inteligencia general artificial) esté disponible», dijo. Siendo el sistema “la sociedad, Internet, las instituciones gubernamentales, etc.»

Polosukhin es una de las figuras clave de la IA generativa. En 2017, fue coautor del artículo de investigación fundamental «La atención es todo lo que necesitas», que presentó la arquitectura Transformer, un nuevo enfoque para la creación de modelos de IA. Este artículo innovador es la razón por la que hay una «T» al final de ChatGPT.

Quitar la caja negra

Muy poco sobre la trayectoria de la IA sorprende al investigador convertido en fundador.

El mismo año en que se publicó el artículo sobre la arquitectura Transformer, Polosukhin lanzó NEAR AI en torno a la idea de que las máquinas eventualmente podrían generar software. Su tesis era que los humanos hablarían con las computadoras en un lenguaje natural, como el inglés, y las máquinas escribirían el código.

«En 2017, parece bastante ridículo», dijo. Hoy se llama codificación de vibraciones.

Polosukhin también aprecia las capacidades que ahora demuestran algunos modelos. antrópico dijo el martes que su último modelo preliminar, Mythos, es tan capaz de encontrar y explotar vulnerabilidades que el laboratorio limita el acceso a ellas.

Polosukhin dijo que había estado advirtiendo durante años que «los modelos empezarían a romperlo todo». Lo describió a Business Insider como un juego del «gato y el ratón», en el que cada iteración del modelo puede romper lo que solucionó el modelo anterior.

En un mundo donde las personas gestionan su salud (o las empresas gestionan su logística) con agentes de inteligencia artificial, Polosukhin ve la necesidad de una capa de confianza y seguridad de back-end destinada a proteger contra estos riesgos.

En NEAR, Polosukhin está construyendo infraestructura para reducir la dependencia de los agentes de IA de una sola empresa, como un laboratorio de IA de vanguardia, para controlar y supervisar cada paso de una tarea.

En la práctica, esto podría significar que un agente de inteligencia artificial (el que administra sus datos de inicio de sesión, reserva su viaje y transfiere dinero para pagar un boleto de avión) no requeriría que un usuario confiara ciegamente en un único guardián.

«Contendrá toda su información», dijo Polosukhin sobre los modelos de IA que procesan datos. «Literalmente, tu vida estará ahí. Así que no quieres que una empresa tenga control o acceso a eso».

Otro riesgo contra el que Polosukhin quiere protegerse es el de la manipulación. La gente utiliza cada vez más la IA para obtener información, desde resúmenes de noticias hasta sugerencias de inversión. Un laboratorio de inteligencia artificial, o un actor malicioso dentro de él, podría moldear silenciosamente estas respuestas, dijo Polosukhin.

Un ejemplo vino el año pasado de xAI, cuando Grok se refirió repetidamente al «genocidio blanco» en respuestas no relacionadas a lo que la compañía llamó «modificaciones no autorizadas» en su backend.

El objetivo de Polosukhin con NEAR es desarrollar una plataforma verificable de código abierto que brinde a los usuarios una mayor visibilidad de cómo funciona un sistema de inteligencia artificial, en lugar de tratarlo como una caja negra.

La supervisión es lo que la IA todavía necesita

Por el momento, sus propios agentes no son del todo fiables.

Polosukhin mostró a Business Insider cómo uno de sus agentes puede agregar información sobre el alto el fuego entre Estados Unidos e Irán y proporcionar inteligencia de mercado. Otros son «agentes de desarrollo» que codifican y un «agente de crecimiento» que puede sugerir pasos para aumentar una determinada métrica en su negocio.

Por muy útiles que sean, Polosukhin no deja que una IA se suelte. El investigador afirma que los sistemas de IA todavía necesitan una atención especial.

Dice que la IA todavía lucha con el discernimiento, a pesar de que las conversaciones en línea sobre ella pueden exagerar su progreso actual.

«Si me dejo llevar y corro y hago cosas, vuelvo a algo que no tiene ningún sentido», dijo sobre los modelos de IA. «Así que tienes que cumplir con tu criterio».

:max_bytes(150000):strip_icc():format(jpeg)/suttle-lake-oregon-052826-2600e9d7376745fa8506ffb58e83780b.jpg?w=100&resize=100,75&ssl=1)